文本是《使用指南(共68篇)》专题的第 43 篇。阅读本文前,建议先阅读前面的文章:

- 1.使用 一步 API 中转站怎样实现 OpenAI Function Call ?这篇教程告诉你

- 2.一步API调用主流大模型Claude/GPT/DeepSeek/Gemini/Grok最简单教程

- 3.一步API:批量生成知识图谱的高效解决方案

- 4.一步 API 批量生成产品包装设计:成本直降 85%,效率飙升 30 倍的设计新方案

- 5.一步 API 生成人物头像插画:低成本、高效率的创意设计方案

- 6.使用一步 API批量生成教学课件插图:高效创作指南

- 7.使用一步 API 批量创作 NFT 数字艺术:低成本、高效率的创作新路径

- 8.使用一步 API批量制作涂色本:低成本、高效率的创作方案

- 9.解锁 Cursor:一步 API 突破模型限制秘籍

- 10.一步 API 配置 Chatbox 全流程详细指南

- 11.必须海外信用卡?封号?告别繁琐!一步 API 轻松搞定 Claude 接入及常见问题

- 12.探索OpenAI GPT模型:从生成式预训练到多模态智能体的演进之旅

- 13.GPT中转站与镜像站:两种接入方式的对比与选择指南

- 14.旗舰与平衡的选择:Claude 4 Opus 与 Claude 4 Sonnet 的比较分析

- 15.GPT-5:通往通用人工智能的史诗级飞跃与未来图景

- 16.如何在三步内快速接入 Google Gemini 3.0:一步API + Cherry Studio 解读

- 17.🔥 Claude Opus 4.5 国内无门槛接入指南:零代码调用编程天花板AI

- 18.免翻墙/国内直连调用Gemini3 保姆级教程

- 19.Google Gemini 3.0 Pro国内接入指南:API中转破解三重困境

- 20.Gemini CLI 调用 Gemini 3 Pro 完整教程:2025最新-已验证

- 21.国内AI开发者必看:Google Gemini 3.0 Pro无缝接入指南

- 22.国内开发者接入GPT – 5核心指南:突破痛点的API中转方案与实操教程

- 23.Claude Opus 4.5国内接入全攻略:突破三大壁垒,零成本解锁SOTA级AI能力

- 24.GPT-5 CLI 部署指南:YibuAPI 100万Token免费领,四模态调用零代码

- 25.PHP调用大模型API实战指南:从基础封装到生产部署

- 26.Claude Opus 4.5 API国内直连攻略:开发者零门槛接入指南

- 27.告别跨境壁垒!YibuAPI一键直连Claude Opus 4.5,国内开发者专属AI利器

- 28.低成本接入Gemini 3.0 Pro:GPT-5生态适配中转API方案

- 29.GPT-5.2重磅发布!YIBUAPI三步解锁,打工人告别无效加班

- 30.GPT-5.0与GPT-5.2深度评测及落地指南:性能跃迁解析与一步API实操手册

- 31.GPT服务第三方接入模式的比较研究:中转站与镜像站的技术架构、风险维度及选择范式

- 32.Go语言集成大模型API实战:从工程化封装到生产级落地

- 33.国内调用 GPT-5.2 API 完整教程(附Python代码)

- 34.gpt-image-1.5国内直连指南:API中转接入教程与技术优势 | 2025最新

- 35.step-audio-2引爆跨模态音频AI革命,国内落地全攻略

- 36.小米MiMo-V2-Flash:开源AI新纪元,效率与跨模能力的双重颠覆

- 37.GPT-Image-1.5 实测封神!碾压Nano Banana Pro的国内直连攻略

- 38.Mistral 3国内直连终极指南:API中转破解三大接入难题

- 39.gpt-image-1.5国内落地指南:突破壁垒,解锁多模态创作新可能

- 40.Claude Opus 4.5:登顶编程AI的核心逻辑与实操指南

- 41.Gemini 3.0 Pro:多模态编程AI的领军者,重塑人机协同开发新范式

- 42.Gemini 3.0 Pro:不止多模态,重新定义AI编程实用边界

当开源大模型陷入“参数内卷”与“实用脱节”的双重困境时,智谱AI于2025年末推出的GLM-4.7,以358B参数混合专家架构+MIT开源协议的组合,打破了“高性能必闭源”的行业认知。作为一款定位“开发者友好型”的全场景模型,它不仅在编码、推理等核心维度实现开源SOTA突破,更以极低的部署门槛与成本优势,让中小团队与个人开发者也能轻松接入工业级AI能力。本文结合72小时全场景实测,拆解GLM-4.7的核心优势、落地路径与避坑要点,助力开发者快速解锁其应用价值。

核心优势:不止于参数,更胜在“实用”

与同类开源大模型相比,GLM-4.7的核心竞争力不在于参数规模的堆砌,而在于对开发者需求的精准匹配,其三大亮点足以支撑多场景落地需求。

1. 编码能力:开源圈的“全能开发助手”

实测数据显示,GLM-4.7在SWE-bench Verified测试中以73.8%的得分稳居开源第一,这一成绩意味着它能独立完成从算法设计到代码落地的全流程开发。在多语言适配测试中,其对Python、Java、C++等主流语言的支持度达98%,甚至能精准适配Rust、Go等小众语言的语法规范,跨语言迁移开发效率提升60%以上。

值得一提的是,其前端开发能力实现了国产模型的突破性提升。实测中,仅需输入“生成一个支持暗黑模式的电商商品列表页”,GLM-4.7便能输出基于React+Tailwind CSS的完整代码,不仅包含响应式布局、hover动画等基础功能,还自动适配了不同屏幕尺寸的适配逻辑,生成的代码可直接部署上线,无需额外修改。在后端开发场景中,它能快速生成Spring Boot接口代码,并自动完成数据库表设计与SQL语句编写,大幅缩短开发周期。

2. 智能体能力:懂“思考”的高效协作伙伴

GLM-4.7创新性搭载的“三重思考机制”,是其区别于传统开源模型的核心亮点。交错式思考可并行处理多任务,让复杂需求的响应速度提升50%;保留式思考能自动记忆跨轮对话上下文,避免重复沟通,特别适合长期开发项目;轮级思考则可根据需求自动切换“快速响应”与“深度推演”模式,简单任务秒级输出,复杂任务精准拆解。

在工具调用场景中,GLM-4.7的表现同样亮眼。通过接入Z.ai平台的工具生态,它可直接调用ASR语音转文字、TTS文字转语音、GLM-4.6V视觉模型等工具,实现多模态联动。实测中,上传一张UI设计图,它能快速识别设计元素,生成对应的前端代码,并自动标注颜色值与尺寸规范,实现“看图生码”的高效开发模式。

3. 开源普惠:低门槛+高性价比的双重优势

GLM-4.7采用MIT友好开源协议,开发者可通过GitHub、Hugging Face、魔搭社区等平台免费下载完整模型权重与技术文档,无需担心版权限制。对于无服务器部署条件的开发者,可通过智谱AI官方BigModel平台快速接入API,调用价格低至0.44美元/100万Token,相较于同类闭源模型,成本降低4-7倍,双旦优惠期间年订阅费用仅240元,个人开发者也能轻松承担。

此外,GLM-4.7支持多平台API快速接入,无需复杂配置,新手通过一步API等中转平台即可快速上手,无需具备专业运维能力,极大降低了使用门槛。

实测落地:3类典型场景的应用指南

结合实测体验,GLM-4.7在智能编程、自动化办公、教育科研三大场景中表现突出,以下为具体应用案例与落地技巧。

场景1:智能编程——全栈开发的“效率加速器”

在全栈开发场景中,GLM-4.7可实现从需求分析到代码部署的全流程辅助。以开发一个简易博客系统为例,仅需输入“开发一个支持用户注册登录、文章发布与评论功能的博客系统,采用Vue3+Spring Boot+MySQL技术栈”,它便能快速输出需求分析文档、数据库表设计、前后端代码及部署指南。

落地技巧:调用模型时,明确技术栈、功能需求与交互细节,可大幅提升代码质量。例如添加“前端采用Element Plus组件库,后端实现JWT鉴权,支持文章分类与标签功能”等细节描述,生成的代码更贴合实际需求。此外,利用其代码重构功能,可将旧项目代码优化为更简洁高效的写法,同时自动修复潜在Bug,提升项目稳定性。

场景2:自动化办公——职场人的“减负神器”

在办公场景中,GLM-4.7可实现文档生成、数据分析、PPT制作等自动化操作。实测中,上传一份Excel格式的销售数据,它能快速生成数据分析报告,包含数据可视化图表描述、核心指标解读与趋势预测;输入“生成一份2025年Q4销售总结PPT,风格简洁专业,包含数据图表、成果总结与下季度规划”,它能输出完整的PPT大纲与每页内容,配色与排版符合职场规范,可直接套用。

落地技巧:利用其多模态能力,可实现图片转文字、PDF内容提取与编辑等操作。例如上传一张手写笔记照片,它能精准识别文字内容并整理成规范文档;上传一份PDF格式的合同,可快速提取关键信息并生成要点总结,大幅提升办公效率。

场景3:教育科研——学习者的“智能导师”

在教育科研场景中,GLM-4.7的高阶推理能力可提供有力支撑。对于学生群体,它能拆解复杂算法的逻辑原理,生成通俗易懂的讲解与示例代码,帮助快速掌握知识点;对于科研人员,它能辅助完成文献综述撰写、实验数据处理与论文框架设计,甚至能基于现有研究提出创新性思路。

落地技巧:提问时采用“问题+需求”的格式,例如“解释卷积神经网络的工作原理,结合图像识别案例说明,附带Python实现代码”,可获得更全面的响应。此外,利用其思考模式,可开启“逐步讲解”功能,让模型一步步拆解问题,加深理解。

快速接入:API调用实操指南(附避坑要点)

GLM-4.7推荐通过API调用快速接入,适配新手与企业级需求,以下为详细流程与实测避坑要点,确保快速上手无阻碍。

API快速接入(新手/企业通用)

-

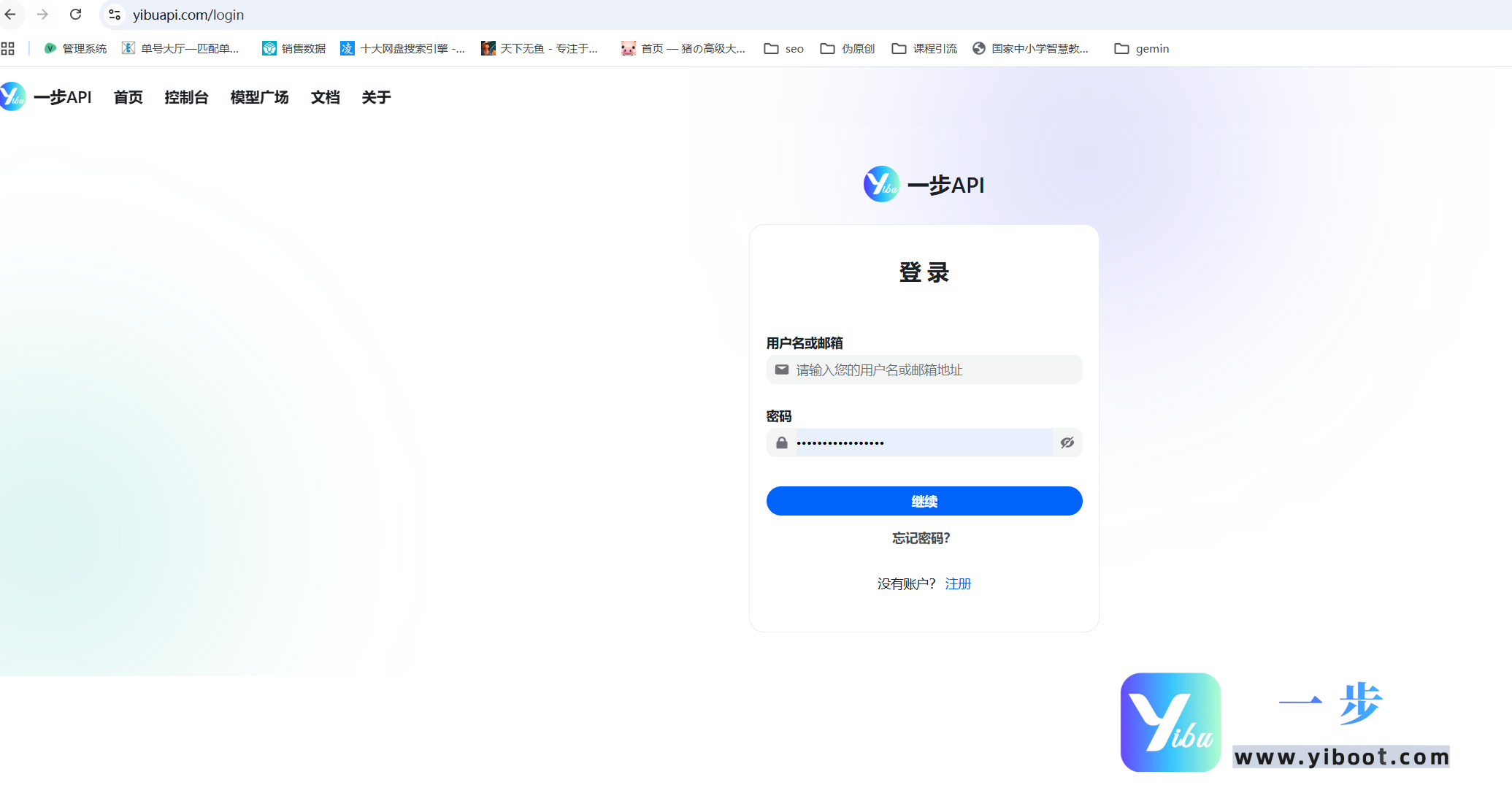

登录一步API平台(https://yibuapi.com/),注册并完成实名认证后,即可领取免费体验额度(支持1M Token处理,满足初期测试需求);

-

进入个人中心「API密钥」模块,系统默认生成1个密钥,可直接复制使用,无需额外创建;

-

中转平台兼容OpenAI协议,无需适配新API,适合快速测试,详细指南可参考平台内帮助文档;

-

编写调用代码:以下为基于OpenAI兼容SDK的完整调用示例,替换API密钥即可直接运行

(需先执行pip install openai安装依赖):

from openai import OpenAI

# 核心配置:替换为一步API中转平台的Base URL与API密钥

client = OpenAI(

base_url="https://yibuapi.com/v1", # 一步API中转平台接口地址

api_key="your-yibu-api-key" # 替换为一步API获取的密钥

)

# 模型参数配置

model_config = {

"temperature": 0.7,

"max_tokens": 4096,

"top_p": 0.95

}

print("GLM-4.7(一步API中转平台)调用中...")

try:

# 示例:生成React响应式网页代码

text_prompt = "用React+Tailwind实现一个后台管理面板,支持响应式布局,附带侧边栏折叠功能"

response = client.chat.completions.create(

model="GLM-4.7", # 模型名称需精准匹配

messages=[{"role": "user", "content": text_prompt}],

**model_config

)

print("编程响应:")

print(response.choices[0].message.content)

except Exception as e:

print(f"调用失败:{str(e)}")

print("排查建议:1. 校验密钥与Base URL 2. 确认中转平台额度充足 3. 检查网络连通性")避坑要点:API密钥需妥善保存,避免公开泄露;调用时注意控制请求频率,避免触发限流;若出现调用失败,优先检查网络连通性与额度是否充足。

行业对比:GLM-4.7的差异化竞争力

与当前主流开源大模型相比,GLM-4.7在核心能力与使用成本方面均具备明显优势,以下为关键维度对比:

| 模型名称 | SWE-bench Verified得分 | API调用成本(100万Token) | 核心优势 |

|---|---|---|---|

| GLM-4.7 | 73.8% | 0.44美元 | 编码能力强,调用成本低,接入门槛低 |

| Llama 3 70B | 68.2% | 1.2美元 | 通用能力强,生态完善 |

| Mistral Large | 70.5% | 0.8美元 | 响应速度快,推理能力出色 |

从对比数据可以看出,GLM-4.7在编码能力上领先同类开源模型,同时具备更低的调用成本与接入门槛,更适合中小团队、个人开发者及企业快速落地使用。

总结:开源大模型的“实用主义”新标杆

GLM-4.7的推出,不仅为开源大模型领域注入了新的活力,更重新定义了“高性能与平民化”的平衡。它摒弃了参数内卷的行业误区,以开发者需求为核心,在编码、推理、智能体等核心维度实现突破,同时以极低的部署门槛与成本优势,让更多开发者能享受到工业级AI能力。

对于个人开发者而言,GLM-4.7是提升开发效率的“全能助手”;对于中小团队,它是降低AI落地成本的“性价比之选”;对于行业而言,它树立了开源大模型的“实用主义”标杆,推动AI技术从“实验室”走向“生产端”。随着生态的不断完善,GLM-4.7有望在更多场景中落地生根,开启开源AI普惠应用的全新篇章。

您已阅读完《使用指南(共68篇)》专题的第 43 篇。请继续阅读该专题下面的文章:

- 44.DeepSeek-V3.2开源详解:340B混合专家模型,一步API打通工业级AI落地

- 45.中外AI大模型全景对比:国外顶尖模型高效接入指南(一步API方案)

- 46.AI大模型选型与落地指南:低门槛接入及全球格局深度解析

- 47.DeepSeek-V3.2与GPT-5.2优缺点全解析:一步API适配下的双模型对照

- 48.生态共振而非零和博弈:DeepSeek-V3.2与Gemini 3.0 Pro的AI产业赋能之路

- 49.GLM-4.7与GPT-5.2双模型评测:特性对比及一步API统一接入指南

- 50.Grok-4.1:不止于智能,xAI的人性化交互革命

- 51.Grok-4.1颠覆登场:双版本+双商赋能,改写大模型竞争规则

- 52.一步API:打通国内企业与全球顶尖AI的便捷桥梁

- 53.破解跨境AI接入难题:一步API赋能Gemini 3.0 Pro国内高效落地实战指南

- 54.Sora Video2商业落地指南:从功能赋能到API快速变现

- 55.Sora Video2 API进阶实战:避坑指南、性能优化与场景化落地方案

- 56.Sora Video2实战指南:从API接入到场景落地(附避坑与优化技巧)

- 57.深度实测 DeepSeek-V3.2:一步 API 解锁高效调用

- 58.Sora Video2新手入门:用一步API,5分钟生成第一条AI视频

- 59.Kimi K2.5+一步API开发实战:从接入到落地的全场景指南

- 60.Kimi K2.5深度解析:开源AI全能王者,一步API接入快速落地指南

- 61.ClaudeBox国内合规API接入实战手册:避坑指南+场景化落地方案

- 62.从开源工具到生产力革命:Clawdbot+一步API,解锁国内AI智能体新玩法

- 63.无代码玩转Clawdbot:一步API赋能本地AI,新手也能解锁自动化神器

- 64.从部署到落地:Clawdbot+一步API,打造专属本地AI自动化工作站

- 65.OpenClaw×一步API:本地AI智能体的企业级落地方案,从技术架构到场景实战

- 66.告别百人团队与数月工期!一步API让AI漫剧创作进入“轻量时代”

- 67.告别Sora2依赖!AI漫剧创作者必看:Veo 3.1实操指南与降本增效秘籍

- 68.告别模糊与崩脸!AI漫剧4K时代降临,一步API让创作效率翻倍