文本是《使用指南(共68篇)》专题的第 60 篇。阅读本文前,建议先阅读前面的文章:

- 1.使用 一步 API 中转站怎样实现 OpenAI Function Call ?这篇教程告诉你

- 2.一步API调用主流大模型Claude/GPT/DeepSeek/Gemini/Grok最简单教程

- 3.一步API:批量生成知识图谱的高效解决方案

- 4.一步 API 批量生成产品包装设计:成本直降 85%,效率飙升 30 倍的设计新方案

- 5.一步 API 生成人物头像插画:低成本、高效率的创意设计方案

- 6.使用一步 API批量生成教学课件插图:高效创作指南

- 7.使用一步 API 批量创作 NFT 数字艺术:低成本、高效率的创作新路径

- 8.使用一步 API批量制作涂色本:低成本、高效率的创作方案

- 9.解锁 Cursor:一步 API 突破模型限制秘籍

- 10.一步 API 配置 Chatbox 全流程详细指南

- 11.必须海外信用卡?封号?告别繁琐!一步 API 轻松搞定 Claude 接入及常见问题

- 12.探索OpenAI GPT模型:从生成式预训练到多模态智能体的演进之旅

- 13.GPT中转站与镜像站:两种接入方式的对比与选择指南

- 14.旗舰与平衡的选择:Claude 4 Opus 与 Claude 4 Sonnet 的比较分析

- 15.GPT-5:通往通用人工智能的史诗级飞跃与未来图景

- 16.如何在三步内快速接入 Google Gemini 3.0:一步API + Cherry Studio 解读

- 17.🔥 Claude Opus 4.5 国内无门槛接入指南:零代码调用编程天花板AI

- 18.免翻墙/国内直连调用Gemini3 保姆级教程

- 19.Google Gemini 3.0 Pro国内接入指南:API中转破解三重困境

- 20.Gemini CLI 调用 Gemini 3 Pro 完整教程:2025最新-已验证

- 21.国内AI开发者必看:Google Gemini 3.0 Pro无缝接入指南

- 22.国内开发者接入GPT – 5核心指南:突破痛点的API中转方案与实操教程

- 23.Claude Opus 4.5国内接入全攻略:突破三大壁垒,零成本解锁SOTA级AI能力

- 24.GPT-5 CLI 部署指南:YibuAPI 100万Token免费领,四模态调用零代码

- 25.PHP调用大模型API实战指南:从基础封装到生产部署

- 26.Claude Opus 4.5 API国内直连攻略:开发者零门槛接入指南

- 27.告别跨境壁垒!YibuAPI一键直连Claude Opus 4.5,国内开发者专属AI利器

- 28.低成本接入Gemini 3.0 Pro:GPT-5生态适配中转API方案

- 29.GPT-5.2重磅发布!YIBUAPI三步解锁,打工人告别无效加班

- 30.GPT-5.0与GPT-5.2深度评测及落地指南:性能跃迁解析与一步API实操手册

- 31.GPT服务第三方接入模式的比较研究:中转站与镜像站的技术架构、风险维度及选择范式

- 32.Go语言集成大模型API实战:从工程化封装到生产级落地

- 33.国内调用 GPT-5.2 API 完整教程(附Python代码)

- 34.gpt-image-1.5国内直连指南:API中转接入教程与技术优势 | 2025最新

- 35.step-audio-2引爆跨模态音频AI革命,国内落地全攻略

- 36.小米MiMo-V2-Flash:开源AI新纪元,效率与跨模能力的双重颠覆

- 37.GPT-Image-1.5 实测封神!碾压Nano Banana Pro的国内直连攻略

- 38.Mistral 3国内直连终极指南:API中转破解三大接入难题

- 39.gpt-image-1.5国内落地指南:突破壁垒,解锁多模态创作新可能

- 40.Claude Opus 4.5:登顶编程AI的核心逻辑与实操指南

- 41.Gemini 3.0 Pro:多模态编程AI的领军者,重塑人机协同开发新范式

- 42.Gemini 3.0 Pro:不止多模态,重新定义AI编程实用边界

- 43.GLM-4.7开源实测:358B参数大模型的平民化落地指南

- 44.DeepSeek-V3.2开源详解:340B混合专家模型,一步API打通工业级AI落地

- 45.中外AI大模型全景对比:国外顶尖模型高效接入指南(一步API方案)

- 46.AI大模型选型与落地指南:低门槛接入及全球格局深度解析

- 47.DeepSeek-V3.2与GPT-5.2优缺点全解析:一步API适配下的双模型对照

- 48.生态共振而非零和博弈:DeepSeek-V3.2与Gemini 3.0 Pro的AI产业赋能之路

- 49.GLM-4.7与GPT-5.2双模型评测:特性对比及一步API统一接入指南

- 50.Grok-4.1:不止于智能,xAI的人性化交互革命

- 51.Grok-4.1颠覆登场:双版本+双商赋能,改写大模型竞争规则

- 52.一步API:打通国内企业与全球顶尖AI的便捷桥梁

- 53.破解跨境AI接入难题:一步API赋能Gemini 3.0 Pro国内高效落地实战指南

- 54.Sora Video2商业落地指南:从功能赋能到API快速变现

- 55.Sora Video2 API进阶实战:避坑指南、性能优化与场景化落地方案

- 56.Sora Video2实战指南:从API接入到场景落地(附避坑与优化技巧)

- 57.深度实测 DeepSeek-V3.2:一步 API 解锁高效调用

- 58.Sora Video2新手入门:用一步API,5分钟生成第一条AI视频

- 59.Kimi K2.5+一步API开发实战:从接入到落地的全场景指南

2026年1月27日,月之暗面正式官宣开源Kimi系列重磅迭代模型——K2.5,创始人杨植麟直言其为“Kimi史上综合能力最强的开源全能模型”。这款集多模态交互、百人级Agent集群协作、顶级编码与长文档处理能力于一体的AI旗舰,不仅在多项权威基准测试中斩获桂冠,更凭借极简的一步API接入方案,打破了AI技术落地的技术壁垒,让个人开发者与企业团队无需深耕底层技术,就能快速将AI能力集成到各类应用场景中。本文将从技术亮点、核心价值、实战接入等维度展开深度解析,配套可直接运行的代码示例与避坑手册,助力开发者高效上手K2.5。

一、核心能力跃迁:K2.5凭什么成为开源AI新标杆?

Kimi K2.5基于K2基础架构完成全链路优化,依托15万亿级“视觉+文本”混合训练数据底座,实现了从“单一任务专家”到“多场景协同系统”的核心跃迁。其三大核心能力突破,不仅填补了开源模型的多项技术空白,更让其性能直逼顶级闭源模型。

1. 百人Agent集群协作:复杂任务效率呈指数级提升

K2.5最具革命性的升级,在于支持自主调度100个子智能体组成协作集群,可并行完成最高1500次工具调用,全程无需人工干预角色分配与任务流转。模型能够自动实现“任务拆解→子任务分配→并行执行→结果校验→汇总输出”的全流程闭环,相较于传统单智能体模式,处理复杂多步骤任务的效率提升4.5倍,端到端执行耗时直接缩短80%。

在实际应用场景中,这一能力的价值尤为突出:例如盘点100个细分领域的YouTube顶级创作者时,集群内子智能体可同时并行搜索、数据清洗、结构化整理,快速输出标准化信息表格;处理40篇跨领域学术论文的文献综述撰写任务时,子智能体可分工负责文献精读、论点提炼、格式规范、引文标注等工作,自动生成符合学术标准的百页级综述文档,大幅降低科研人员的重复劳动成本。

2. 全栈多模态交互:零门槛实现创意与技术的闭环落地

依托大规模视觉-文本联合预训练技术,K2.5实现了图片、视频、主流办公文档(PDF/Word/Excel/PPT等)的全场景精准理解,无需额外集成OCR、视频解析、文档解析等第三方工具。更值得关注的是,其多模态能力并非局限于内容识别,而是实现了“创意输入→技术落地”的完整闭环——无论是上传一张网页设计草图、一张产品原型截图,还是仅输入自然语言描述(如“生成一个带动态导航栏和数据可视化模块的企业官网落地页”),K2.5都能直接输出可运行的HTML/CSS/JS完整代码,让非技术出身的设计师、产品经理也能快速将创意转化为实际成果。

在长文档处理领域,K2.5更是刷新了开源模型的性能纪录:在mniDocBench 1.5权威测试中以88.8分夺冠,支持百页级长文档无截断处理,同时具备跨文档对比分析、关键信息提取、自动总结等核心能力,完美适配企业办公、科研教育、法律合规等高频长文档处理场景。

3. 顶级性能+极致性价比:开源模型的普惠之选

在核心能力评测中,K2.5展现出了碾压级的实力:Agent综合推理(HLE-Full)、浏览交互(BrowseComp)、深度搜索问答(DeepSearchQA)三大核心榜单稳居第一;编码能力方面,在SWE-Bench Verified、多语言编码综合测试中双双夺冠,全面支持Python、Java、JavaScript、Go等主流编程语言,能够高效完成算法实现、Bug修复、项目重构等开发任务。

在定价方面,K2.5更是延续了开源模型的普惠属性,性价比远超同类主流模型:输入每百万Token仅需4元,缓存输入(重复内容)低至0.7元/百万Token,输出每百万Token 21元,无论是个人开发者的小场景测试,还是企业的规模化应用,都能有效控制成本。同时,模型提供四种专属模式适配不同场景需求:快速模式(侧重响应速度,适配简单问答)、思考模式(侧重逻辑推理,适配复杂问题)、Agent模式(侧重办公文档生成,适配日常办公)、Agent集群模式(侧重复杂任务并行处理,适配大规模协作场景)。

二、实战指南:一步API接入Kimi K2.5(Python完整版)

为了降低开发者的接入门槛,K2.5专门优化了一步API接入方案,全面兼容openai SDK,核心接入流程仅需4步,涵盖高频的视觉识别与基础的文本交互两大核心场景。以下教程将全程拆解接入细节,配套完整代码与报错解决方案,确保新手也能快速上手、一次成功。

2.1 前置准备:3分钟快速获取API密钥

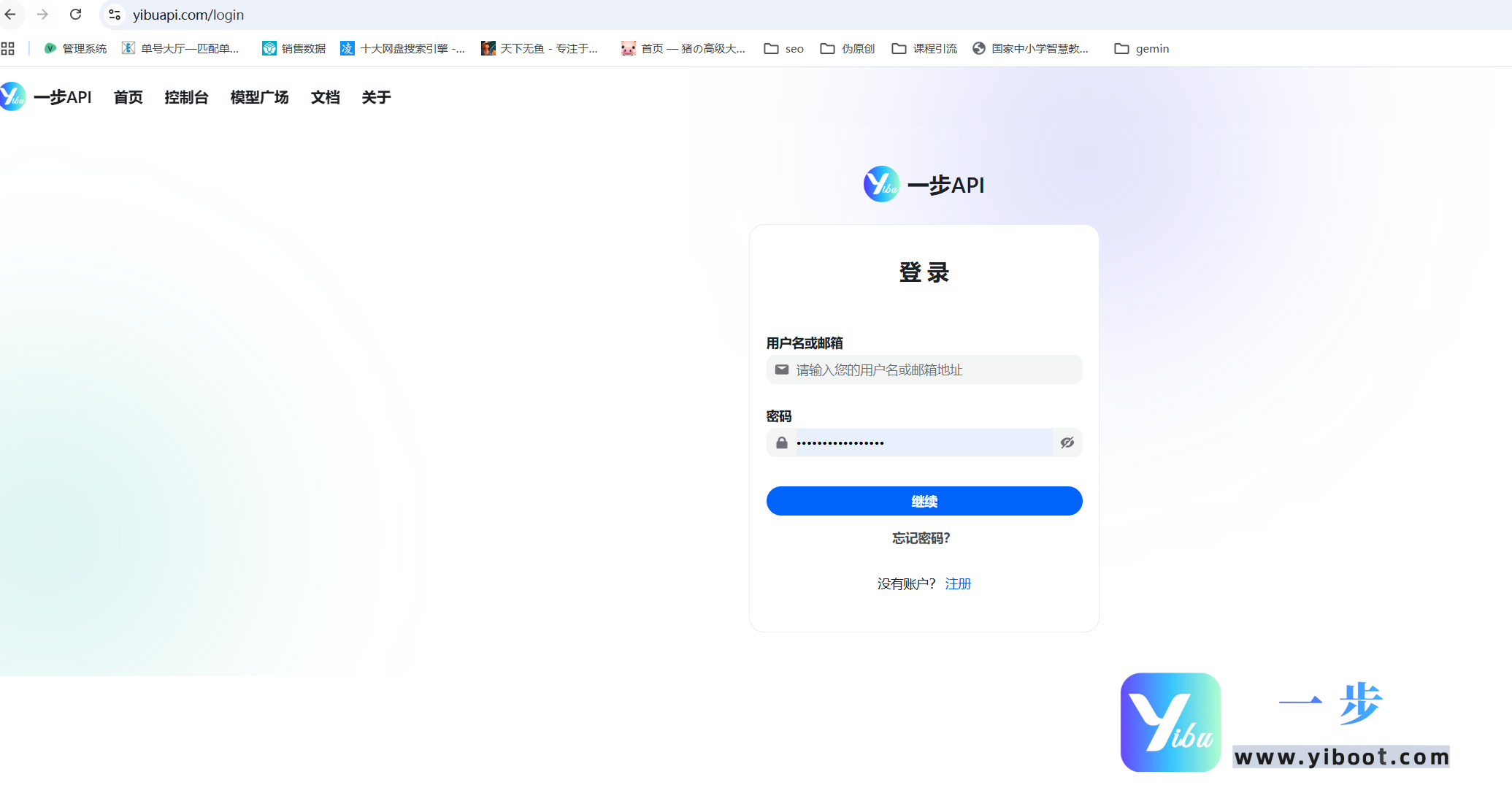

调用K2.5模型前,需先获取一步API专属密钥,操作流程简单易懂,新注册用户可直接获得15元体验余额,足以完成多次场景测试,具体步骤如下:

-

访问一步API官方平台(官方认证渠道,保障安全合规),完成账号注册与实名认证(审核流程快速,通常10分钟内完成);

-

登录账号后,进入控制台页面,找到【API Key管理】功能模块,点击【新建API Key】按钮;

-

自定义API Key名称(建议标注用途,如“Kimi K2.5开发调用”),选择所属项目(无项目可直接新建,无需额外配置),点击“确定”即可生成密钥;

-

生成密钥后,立即复制并保存至安全位置(密钥用于模型调用,请勿泄露给他人,避免产生不必要的成本损失)。

2.2 环境依赖安装:快速配置开发环境

本次教程以Python语言为例(最主流的AI开发语言),需安装openai(兼容一步API调用)和python-dotenv(可选,用于环境变量管理)两个核心库。为避免兼容性问题,建议将openai库升级至1.0.0及以上版本,执行以下命令即可完成安装与升级:

pip install --upgrade openai python-dotenv2.3 场景一:视觉识别API接入(本地图片+完整代码)

视觉类任务(图片、视频识别等)是K2.5的核心优势场景,调用时需注意:content字段必须使用列表格式(文本任务为字符串格式),这是避免Token超限、格式报错的关键。以下代码实现“本地图片内容精准识别”功能,替换API密钥和图片路径后可直接运行,支持png、jpg、jpeg等主流图片格式。

import os

import base64

from openai import OpenAI

# 核心配置:初始化OpenAI客户端(必改:替换为个人API密钥)

client = OpenAI(

api_key="sk-your-api-key", # 替换为自己获取的一步API密钥

base_url="https://yibuapi.com/v1" # 一步API固定基础地址,无需修改

)

# 步骤1:读取本地图片并进行base64编码(视觉任务必需,不可省略)

image_path = "kimi-test.png" # 必改:替换为本地图片路径(Windows示例:C:/images/test.jpg;Mac/Linux示例:./images/test.png)

if not os.path.exists(image_path):

print(f"错误:图片路径{image_path}不存在,请检查路径是否正确!")

exit()

with open(image_path, "rb") as f:

image_data = f.read()

# 步骤2:构建符合API要求的图片URL(base64格式)

image_ext = os.path.splitext(image_path)[1].strip('.') # 自动识别图片后缀(png/jpg等)

image_url = f"data:image/{image_ext};base64,{base64.b64encode(image_data).decode('utf-8')}"

# 步骤3:调用Kimi K2.5模型,执行视觉识别任务

try:

completion = client.chat.completions.create(

model="kimi-k2.5", # 固定参数,指定调用Kimi K2.5模型

messages=[

{

"role": "system",

"content": "你是专业的多模态视觉识别助手,需精准识别图片中的所有可见元素(文字、物体、颜色、布局、细节等),并给出条理清晰的详细描述。"

},

{

"role": "user",

"content": [

{"type": "image_url", "image_url": {"url": image_url}}, # 传入图片base64信息

{"type": "text", "text": "请详细描述这张图片的内容,包括所有可见元素、布局结构和细节信息,输出格式清晰易懂。"} # 自定义用户指令

]

}

],

temperature=0.6, # 生成稳定性控制:0-1,数值越低结果越固定(视觉识别建议0.5-0.7)

max_tokens=2048 # 最大输出Token数,可根据需求调整(复杂图片建议设置≥2048)

)

# 步骤4:输出识别结果

print("="*50)

print("【Kimi K2.5 视觉识别结果】")

print("="*50)

print(completion.choices[0].message.content)

except Exception as e:

print(f"调用失败,错误信息:{str(e)}")2.4 场景二:文本交互API接入(简化版,适配问答/编码等)

文本交互场景(如智能问答、代码生成、文案创作、逻辑推理等)调用格式更简洁,content字段直接传入字符串即可。以下示例实现“生成带详细注释的Python快速排序算法”功能,替换API密钥后可直接运行,适配各类文本类开发需求。

import os

from openai import OpenAI

# 初始化客户端(必改:替换为个人API密钥)

client = OpenAI(

api_key="sk-your-api-key", # 替换为自己的一步API密钥

base_url="https://yibuapi.com/v1" # 一步API固定基础地址,无需修改

)

# 调用Kimi K2.5模型,执行文本交互任务(代码生成)

try:

completion = client.chat.completions.create(

model="kimi-k2.5", # 固定参数,指定调用Kimi K2.5模型

messages=[

{

"role": "user",

"content": "用Python实现快速排序算法,要求:1. 适配任意整数列表;2. 添加详细的代码注释(每一步说明用途);3. 包含测试用例。" # 自定义文本指令

}

],

temperature=0.5, # 编码场景建议0.5左右,兼顾准确性与灵活性

max_tokens=1024 # 按需调整,代码生成建议≥1024

)

# 输出结果

print("="*50)

print("【Kimi K2.5 文本交互(代码生成)结果】")

print("="*50)

print(completion.choices[0].message.content)

except Exception as e:

print(f"调用失败,错误信息:{str(e)}")2.5 高频报错避坑指南(必看)

结合大量开发者的实战经验,整理了API接入过程中最常见的5类报错场景及解决方案,帮你快速规避问题、提高接入效率:

-

报错1:Token exceeds maximum limit(Token超出上限)→ 核心原因:视觉任务content字段误传为字符串格式,或图片体积过大。解决方案:确认视觉任务content为列表格式;压缩图片体积(建议单张图片不超过5MB);适当降低max_tokens参数。

-

报错2:API key is invalid(API密钥无效)→ 核心原因:密钥复制不完整、存在空格或字符错误,或密钥未激活。解决方案:重新复制密钥并核对(去除前后空格);登录一步API控制台确认密钥状态为“正常”。

-

报错3:No module named ‘openai’(未找到openai模块)→ 核心原因:未安装openai库或安装路径错误。解决方案:重新执行pip install --upgrade openai命令;确认当前Python环境与安装路径一致。

-

报错4:图片无法识别/识别结果异常→ 核心原因:图片路径错误、格式不支持或base64编码失败。解决方案:核对图片路径是否正确(绝对路径优先);确认图片格式为png/jpg/jpeg;检查base64编码代码是否完整。

-

参数优化建议:model字段固定为“kimi-k2.5”,不可修改;temperature参数(0-1):简单任务0.3-0.5(稳定性优先),复杂创意类任务0.7-0.9(多样性优先);max_tokens参数:简单文本任务512-1024,复杂任务(长文档/代码生成)建议≥16000。

三、开源价值与应用前景:K2.5赋能千行百业

Kimi K2.5的开源发布,不仅是月之暗面对开源AI生态的重要贡献,更打破了“顶级AI能力=高接入成本+高技术门槛”的固有认知。其核心价值在于:一方面,填补了开源模型在多模态协作、大规模Agent集群等领域的技术空白,为开发者提供了可自由定制、低成本落地的顶级AI底座;另一方面,通过极简的一步API接入方案,让AI技术不再局限于专业研发团队,个人开发者、中小企业都能快速将AI能力集成到产品与业务中。

从应用场景来看,K2.5的适配范围极为广泛:个人开发者可用于创意落地(视觉编程、文案生成)、效率提升(代码开发、文献整理);企业团队可用于智能办公(多文档处理、自动化报告生成)、科研辅助(文献综述、数据解析)、产品迭代(多模态交互功能集成)等场景。目前,Kimi K2.5已在Hugging Face、魔搭社区等主流开源平台开放下载,开发者可直接获取完整模型,结合本文的API接入教程,快速开启AI开发与应用之旅。

您已阅读完《使用指南(共68篇)》专题的第 60 篇。请继续阅读该专题下面的文章:

- 61.ClaudeBox国内合规API接入实战手册:避坑指南+场景化落地方案

- 62.从开源工具到生产力革命:Clawdbot+一步API,解锁国内AI智能体新玩法

- 63.无代码玩转Clawdbot:一步API赋能本地AI,新手也能解锁自动化神器

- 64.从部署到落地:Clawdbot+一步API,打造专属本地AI自动化工作站

- 65.OpenClaw×一步API:本地AI智能体的企业级落地方案,从技术架构到场景实战

- 66.告别百人团队与数月工期!一步API让AI漫剧创作进入“轻量时代”

- 67.告别Sora2依赖!AI漫剧创作者必看:Veo 3.1实操指南与降本增效秘籍

- 68.告别模糊与崩脸!AI漫剧4K时代降临,一步API让创作效率翻倍